Dünyanın dört bir yanından biriyle konuştuğunuzu ve yüz ifadelerini gerçek zamanlı olarak, sanki tam önünüzde oturuyormuş gibi gördüğünüzü hayal edin. Mohamed bin Zayed Yapay Zeka Üniversitesi’ndeki (MBZUAI) araştırmacıların en son sanal gerçeklik yenilikleriyle vaat ettikleri şey budur.

Üniversitenin Veri Gözlemevinde Khaleej Times’a yapılan bir gösteri sırasında, Bilgisayarla Görme Profesörü ve mbzuaı’nin Metaverse Merkezi Direktörü Hao Li ve doktora öğrencisi Ariana Bermudez, üniversitede geliştirilen iki teknolojiyi sergiledi — Voodoo XP ve XMem ++ — sanal için yeni olanaklar sunan iletişim ve dijital etkileşim.

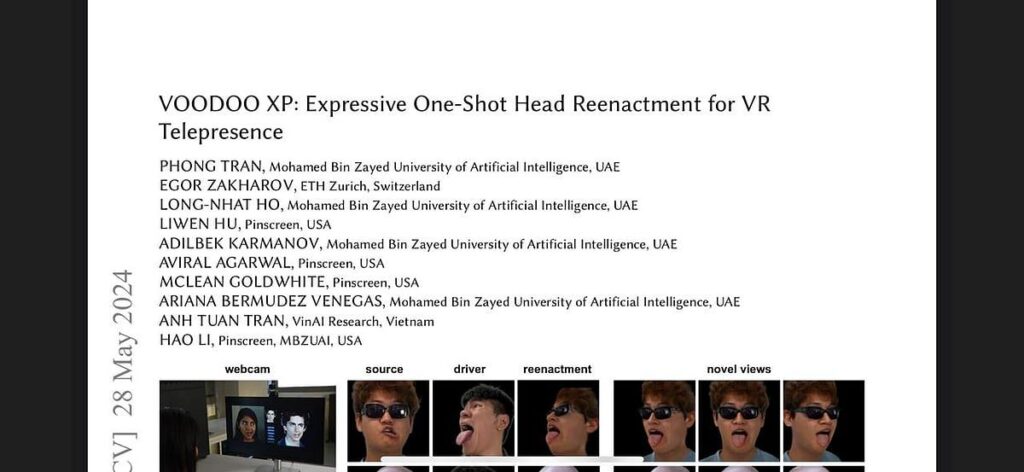

Voodoo XP, yalnızca tek bir fotoğraf kullanarak gerçekçi, gerçek zamanlı yüz canlandırmasına olanak tanır. Profesör Li, her hareketini yansıtan dijital bir avatarı kontrol ederken ”Bunu canlı yapıyoruz” dedi. “Gördüğünüz şey, avatarı gerçek zamanlı olarak kontrol etmem, özel bir donanım olmadan — sadece sıradan bir kamera.” Teknoloji, insanları fiziksel varlığın kısıtlamaları olmadan sanal alanlarda bir araya getirmeyi amaçlıyor.

Bermudez, Voodoo XP’nin geleneksel olarak son derece karmaşık bir süreci nasıl basitleştirdiğini gösterdi. Bunu, 171 kameradan oluşan ayrıntılı bir kurulum ve bir 3D model oluşturmak için saatlerce eğitim gerektiren Meta’nın Codec Avatar sistemiyle karşılaştırdı. “Ama bizim versiyonumuzda sadece bir web kamerasına ihtiyacınız var ve saniyeler içinde bir avatar yaratıyor” diye açıkladı.

Sistem, ince hareketleri ve ifadeleri gerçek zamanlı olarak yakalayarak sanal ortamlarda anında canlandırılabilen avatarlar oluşturur. Bermudez, teknolojinin ne kadar erişilebilir olduğunu, karmaşık ekipman veya veri gerektirmediğini anlattı. “Göz kırpmak veya gülümsemek gibi küçük hareketler bile yakalanır” diye ekledi. Voodoo XP’nin arkasındaki araştırmacılar arasında Phong Tran (MBZUAI öğrencisi), Egor Zakharov (ETH Zürih), Long-Nhat Ho (MBZUAI öğrencisi), Anh Tuan Tran (VınAI Araştırması), Liwen Hu (Pinscreen) ve Profesör Li bulunmaktadır.

Bermudez ayrıca gelişmiş bir video nesnesi segmentasyon yöntemi olan XMem ++’ı da gösterdi. Gelişmiş bellek yönetimi stratejileri ve hafif dikkat mekanizmaları sunarak bellek verimliliğini ve segmentasyon doğruluğunu artırır. Uzun video dizileri için tasarlanan XMem ++, gerçek zamanlı performansı yüksek kaliteli maske yayılımıyla dengeleyerek video düzenleme, artırılmış gerçeklik ve otonom sistemler gibi uygulamalar için uygun hale getirir.

“Bu, filmler için özel efektler yapanlar gibi birçok VFX sanatçısı için sıkıcı bir şey çünkü genellikle ayrıntıları çok hassaslaştırmaları gerekiyor” diye açıkladı. “Araç, üretimi durdurabileceğiniz, düzeltmeleri yapabileceğiniz ve yayabileceğiniz anlamında çok eksiksiz. Böylece buna göre ayarlanacaktır.”

Teknoloji, görsel efektler topluluğu tarafından zaten benimsenmiştir. Endüstri standardı birleştirme yazılımına atıfta bulunarak, ”2023’te piyasaya sürüldüğünde, topluluk onu hemen Nükleer Bombada kullanmaya başladı” dedi. “İşte Nuke ve bu VFX sanatçıları tarafından kullanılan bir araç ve bunu yazılıma dahil ettiler ve temel olarak birisini yok etmek gibi bu tür efektler yapmalarına yardımcı oluyorlar … Bu kullanıcı aracımızı böyle kullanıyor,” dedi cep telefonunda nasıl çalıştığını sergilerken. XMem ++ açık kaynak kodlu ve serbestçe kullanılabilir; “İzleme, iyileştirme konusunda kullanabilecekleri tüm bu özelliklere sahip” diye ekledi. “Gördüğünüz gibi kullanıcı ileri geri gidiyor. Kişiyi seçiyor ve sonra sadece yayılıyor. Sonra maskeleri alır ve izlemenin etkilerini yapabilir.”

Li ve Bermudez’e ek olarak, XMem ++, Maksym Bekuzarov (MBZUAI Mezunları) ve Joon-Young Lee (Adobe) dahil olmak üzere bir araştırmacı ekibi tarafından geliştirilmiştir.